Wie Man KI-Gewohnheiten Beibringt — Und Aufhört, Sich Zu Wiederholen

Lassen Sie mich Ihnen vom schlimmsten Teil meines Arbeitstages erzählen.

Es sind nicht die schweren Probleme. Schwere Probleme machen eigentlich sogar Spaß — es sind Rätsel, und Rätsel haben Lösungen. Nein, der schlimmste Teil ist etwas viel Banaleres.

Es ist Dienstagnachmittag. Ich habe 30 Tabs offen. Drei verschiedene Dokumente, alle mit „final” betitelt. Ein Dutzend Notizen über verschiedene Apps verstreut. Und irgendwo in diesem Chaos — das weiß ich genau — ist der eine Satz, der alles entschlüsseln würde. Die Erkenntnis, die ich gestern hatte. Die Entscheidung, die ich bereits getroffen habe.

Aber ich kann sie nicht finden.

Also fange ich von vorne an. Ich erkläre den Kontext neu. Ich leite die Schlussfolgerung erneut her. Ich verschwende eine Stunde damit, wieder dorthin zu kommen, wo ich schon war.

Kommt Ihnen das bekannt vor?

Der Tag, an dem Sich Alles Änderte

Hier ist, was ich schließlich herausfand: Mein Engpass waren nie die Ideen. Es war nie die Intelligenz, noch die Geschwindigkeit, noch nicht einmal die Zeit. Es war der Zustand. Ich konnte ein komplexes System schnell erfassen — und dann den gesamten Faden verlieren, sobald ich die Aufgabe wechselte.

Und keine Menge an Willenskraft würde das beheben. Ich hatte strengere Notizbücher ausprobiert. Bessere Apps. Mehr Disziplin. Nichts davon funktionierte.

Was schließlich funktionierte, war etwas zu bauen, an das ich nie gedacht hatte zu bauen: ein externes Gedächtnis, dem ich tatsächlich vertrauen konnte. Nicht nur Notizen — sondern dauerhafte Artefakte. Dateien. Checklisten. Workflows. Dinge, die eine KI mir helfen konnte zu erstellen, zu verfeinern und auf Abruf abzurufen.

Dieser Beitrag handelt davon, wie das funktioniert. Nicht die Werkzeuge — Werkzeuge kommen und gehen. Sondern die Prinzipien. Die sieben Ideen, die immer wieder auftauchen, wenn man Menschen beobachtet, die das verstanden haben.

Aber zuerst, lassen Sie uns darüber sprechen, warum die meisten Menschen nie dort ankommen.

Warum Chat-KI an eine Grenze Stößt

Hier ist die Sache mit ChatGPT, Claude, Gemini oder jedem KI-Assistenten, den Sie möglicherweise verwenden: Sie sind unglaublich. Wirklich. Der Sprung von „keine KI” zu „etwas KI” verändert das Leben.

Aber irgendwann stoßen Sie an eine Wand.

Sie stellen eine Frage. Sie bekommen eine Antwort. Vielleicht stellen Sie eine Nachfrage, bekommen eine weitere Antwort. Und dann gehen Sie weiter. Die Konversation verschwindet. Die Erkenntnisse verflüchtigen sich. Nächste Woche, wenn Sie dasselbe Problem haben, fangen Sie komplett von vorne an.

Das ist Chat-KI. Sie ist reaktiv. Sie ist standardmäßig zustandslos. Sie erinnert sich nicht, und sie lernt nicht — zumindest nicht über Sitzungen hinweg.

Agentische KI ist anders.

Nicht weil das Modell intelligenter ist, sondern weil das System darum herum anders ist. Es gibt eine Schleife. Etwas planen. Werkzeuge nutzen, um es auszuführen. Die Ergebnisse verifizieren. Speichern, was Sie gelernt haben, damit es beim nächsten Mal einfacher ist.

Wenn Chat-KI ein brillanter Fremder ist, den Sie auf einer Party treffen — hilfreich für den Abend, dann für immer verschwunden — ist agentische KI ein Mitarbeiter, der Notizen macht, sich an Ihre Präferenzen erinnert und morgen mit einem Plan erscheint.

Der Unterschied ist keine Magie. Es ist Architektur. Und Sie können sie selbst bauen.

Sieben Prinzipien, die Tatsächlich Funktionieren

Ich verbrachte Monate damit, alles zu lesen, was ich von Leuten finden konnte, die KI ernsthaft nutzen. Nicht nur für Demos — für echte Arbeit. Code liefern. Berichte schreiben. Projekte verwalten.

Und etwas Seltsames passierte: Dieselben Ideen tauchten immer wieder auf. Verschiedene Wörter, verschiedene Kontexte, aber dieselben Kernprinzipien. Sie gruppieren sich um drei Dinge, die wir alle zu schützen versuchen: unsere Zeit, unsere Energie und unser Gefühl von Sinn.

Lassen Sie mich Sie durch sie führen.

Die Zeit-Prinzipien

Beginnen Sie mit einem Plan.

Dies ist die wichtigste Lektion und auch die am wenigsten aufregende zu hören: Bevor Sie die KI bitten, etwas zu bauen, schreiben Sie auf, was Sie wollen. Eine Spezifikation. Ein Brief. Eine Ein-Absatz-Beschreibung von „fertig”.

Ich weiß. Es klingt nach zusätzlicher Arbeit. Es fühlt sich nach Bürokratie an.

Aber hier ist, was ohne es passiert: Sie fragen nach etwas vage, die KI gibt Ihnen etwas vage Richtiges, und Sie verbringen die nächste Stunde damit, Randfälle zu beheben, die Sie nie erwähnt haben. Der „schnelle” Ansatz wird langsam. Die Kaninchenlöcher multiplizieren sich.

Mit einer klaren Spezifikation passiert etwas anderes. Die KI hat Einschränkungen. Sie kann nicht abschweifen. Der Suchraum kollabiert zu etwas Handhabbarem. Und plötzlich sind erste Entwürfe tatsächlich gut.

Es gibt einen Satz, der mir im Gedächtnis geblieben ist: „Arbeiten Sie am Anfang langsamer, um insgesamt schneller voranzukommen.” Es klingt paradox, aber jeder, der die Alternative erlebt hat, weiß, dass es wahr ist.

Verifizieren Sie, bevor Sie vertrauen.

Die KI ist selbstbewusst. Immer. Sie wird Ihnen sagen, dass der Code funktioniert. Sie wird Ihnen versichern, dass die Logik solide ist. Und manchmal — oft sogar — hat sie recht.

Aber manchmal nicht.

Das ist keine Kritik. Es ist Physik. Sprachmodelle generieren plausiblen Text. Das ist, was sie tun. Und plausibler Text kann auf Weisen falsch sein, die schwer zu erkennen sind.

Also wird die Regel: Akzeptieren Sie nicht „es ist fertig”. Fordern Sie Beweise. Tests, die bestehen. Diffs, die Sie lesen können. Logs, die die Ausführung zeigen. Behandeln Sie KI-Ausgaben, wie Sie den ersten Versuch eines Junior-Entwicklers behandeln würden — optimistisch, aber einer Überprüfung bedürfend.

Die Operatoren, die am schnellsten vorankommen, sind nicht diejenigen, die blind vertrauen. Es sind diejenigen, die Verifizierung in die Schleife eingebaut haben.

Verwenden Sie git, als ob Ihr Leben davon abhinge.

Wenn Sie jeden Fehler sofort rückgängig machen können, können Sie Risiken eingehen. Wenn Fehler reversibel sind, wird Geschwindigkeit sicher.

Deshalb committen die besten KI-Operatoren ständig. Nicht am Ende eines Features — am Ende jedes kleinen Schritts. Jede atomare Änderung. Jeder Checkpoint.

Denn hier ist die Wahrheit: Wenn die KI schiefgeht (und das wird sie), wollen Sie nicht drei Stunden verschlungener Änderungen debuggen. Sie wollen zu vor fünf Minuten zurücksetzen und es erneut versuchen.

git reset ist schneller als reparieren. Jedes Mal.

Die Energie-Prinzipien

Brechen Sie alles in Atome auf.

Große Aufgaben brechen KI. Ich meine nicht „machen sie langsamer” — ich meine machen sie falsch. Je länger und komplexer die Anfrage, desto wahrscheinlicher ist es, dass das Modell abschweift, den Faden verliert, kleine Fehler zu großen akkumuliert.

Die Lösung ist Zerlegung. Nehmen Sie diese große Aufgabe und zerschlagen Sie sie in Stücke, die klein genug sind, dass Sie sie selbst in 15 oder 20 Minuten erledigen könnten. Schritte, die so klar sind, dass „fertig” offensichtlich ist.

Hier ist ein Test: Wenn Sie nicht sagen können, ob ein Schritt abgeschlossen ist, ist er zu groß. Zerlegen Sie ihn weiter.

Das fühlt sich zunächst mühsam an. Aber die Belohnung ist enorm. Jeder kleine Schritt gelingt. Jeder kleine Erfolg baut auf dem letzten auf. Und plötzlich wird das unmögliche Projekt zu einer Reihe lösbarer Probleme.

Externalisieren Sie Ihren Kontext.

Hier ist, was Ihnen niemand über lange KI-Sitzungen erzählt: Sie degradieren.

Am Anfang erinnert sich die KI an alles. Das Ziel. Die Einschränkungen. Die Entscheidungen, die Sie auf dem Weg getroffen haben. Aber wenn die Konversation wächst, füllt sich das Kontextfenster. Alte Informationen werden herausgedrängt. Die KI beginnt zu vergessen.

Und Sie bemerken es nicht — nicht am Anfang. Die Antworten klingen immer noch selbstbewusst. Aber sie driften. Langsam, subtil verliert die KI den Faden. Und Sie verbringen mehr und mehr Energie damit, Dinge, die Sie bereits abgedeckt haben, erneut zu erklären.

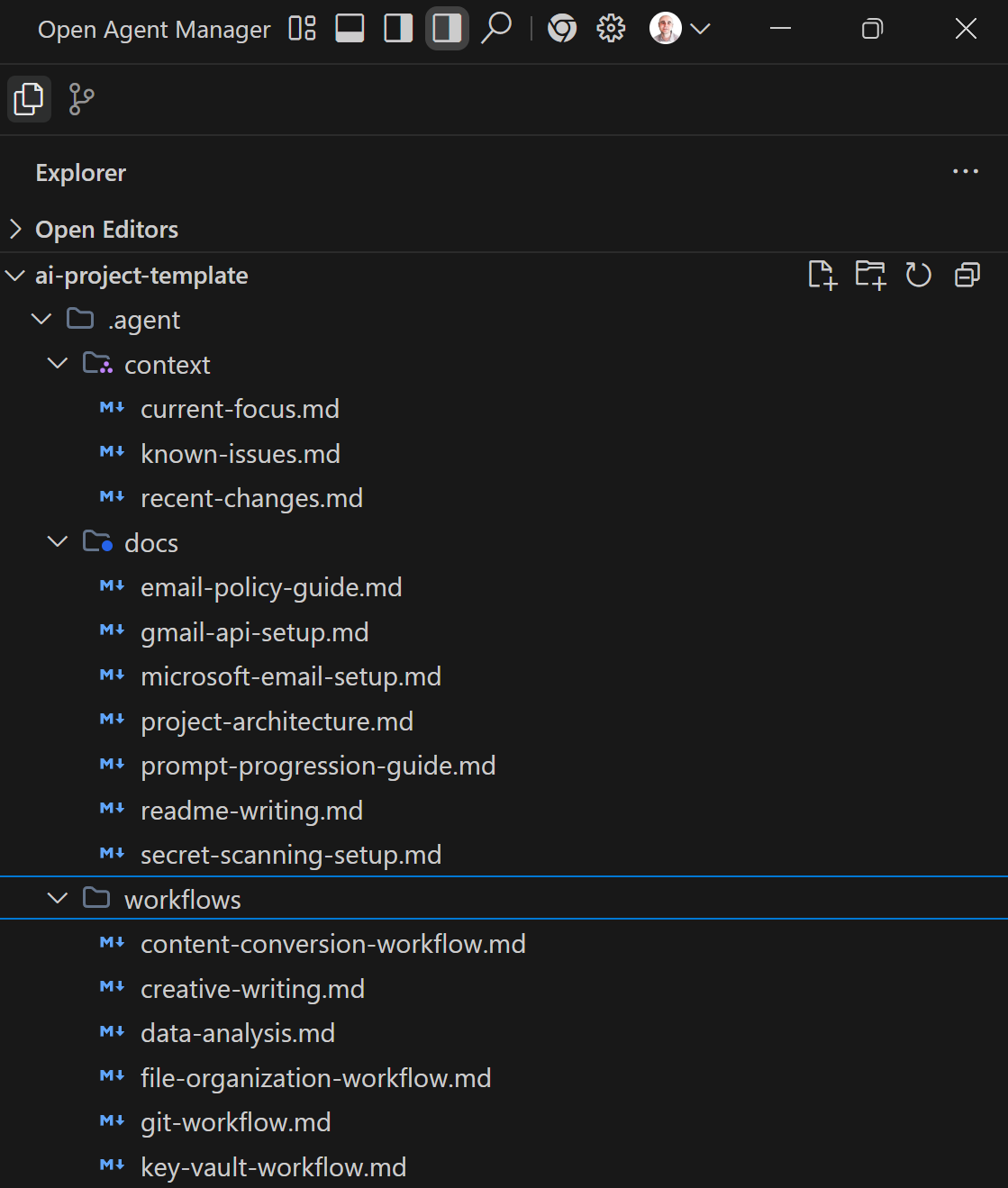

Die Lösung ist kontraintuitiv: Hören Sie auf, sich auf die Konversation zu verlassen, um sich an Dinge zu erinnern. Stattdessen externalisieren Sie Ihren Kontext. Führen Sie eine Datei, die das aktuelle Ziel, die wichtigsten Entscheidungen, die offenen Fragen erfasst. Füttern Sie sie der KI zu Beginn jeder Sitzung.

Meiner Erfahrung nach kann diese einzige Praxis — das Führen einer lebenden Zustandsdatei — die Agenten-Drift dramatisch reduzieren. Die KI vergisst nicht, weil Sie sie nicht bitten, sich zu erinnern.

Das Sinn-Prinzip

Trennen Sie die Rollen.

Es gibt einen Handel im Herzen der Arbeit mit KI: Sie denken, sie führt aus. Sie treffen die strategischen Entscheidungen — was zu bauen ist, warum es wichtig ist, wie gut aussieht. Die KI erledigt die taktische Arbeit — Syntax, Boilerplate, die mühsamen Teile, die Ihre Aufmerksamkeit aufzehren.

Wenn das funktioniert, ist es schön. Sie bleiben in der kreativen, strategischen Zone. Die frustrierende, repetitive Arbeit verschwindet. Flow wird wieder möglich.

Wenn es zusammenbricht — wenn Sie anfangen, die Arbeit der KI für sie zu erledigen, oder aufhören zu verstehen, was sie produziert — geht etwas verloren. Nicht nur Effizienz, sondern Fähigkeit. Es gibt ein echtes Risiko der „kognitiven Atrophie” — zu vergessen, wie man die Dinge tut, die man ausgelagert hat.

Die Lösung ist Klarheit. Wissen Sie, was Ihres ist. Wissen Sie, was der KI gehört. Schützen Sie Ihre Rolle als Architekt, und lassen Sie die KI der Baumeister sein.

Das Gedächtnis, das es Bleiben Lässt

Sie haben vielleicht ein Muster in diesen Prinzipien bemerkt: Sie alle hängen von Persistenz ab. Pläne, die Sitzungen überleben. Kontext, der nicht degradiert. Entscheidungen, die getroffen bleiben.

Aber KI ist zustandslos. Jedes Mal, wenn Sie eine neue Konversation beginnen, vergisst sie alles.

Also woher kommt die Persistenz?

Von Ihnen. Von den Dateien, die Sie pflegen, den Workflows, die Sie bauen, der Dokumentation, die Sie erstellen. Das ist es, was ich mit einem „externen Gedächtnis” meine — ein System von Artefakten, das außerhalb der KI lebt, das die KI lesen und beschreiben kann, aber das unabhängig persistiert.

Denken Sie daran wie an einen Hippocampus für Ihre Projekte. Das Langzeitgedächtnis, das die KI nicht hat.

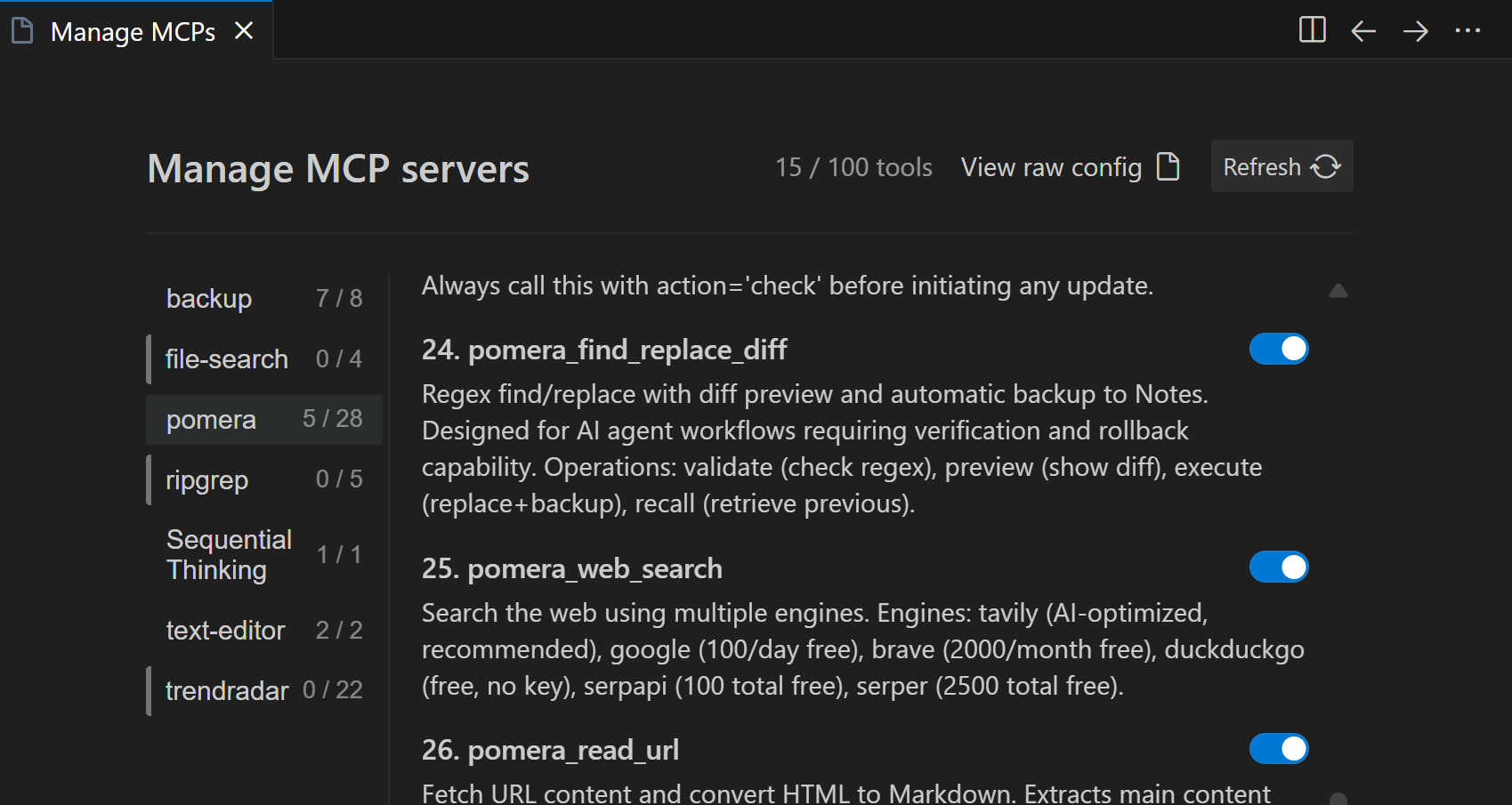

Es gibt jetzt ein Protokoll dafür — einen offenen Standard namens MCP, das Model Context Protocol. Es lässt KI-Systeme sich mit externen Werkzeugen und Datenquellen verbinden. Datenbankabfragen. Web-Suchen. Dateioperationen. All die Dinge, die eine KI in einem Chat-Fenster nicht tun kann, aber plötzlich kann, wenn sie mit den richtigen Servern verbunden ist.

Und hier wird es interessant.

Ein Werkzeug, das Ich Gebaut Habe, Um Dies Zu Lösen

Ich stieß immer wieder auf dieselben Probleme.

Kontext, der zwischen Sitzungen verschwand. Wichtige Entscheidungen, die in der Chat-Historie verloren gingen. Recherche, die Token verbrannte, nur um HTML zu parsen. JSON-Dateien, die sich auf Weisen änderten, die ich nicht verfolgen konnte.

Also baute ich etwas, um das zu beheben.

Es heißt Pomera, und es ist ein MCP-Server, der mit jeder IDE funktioniert, die das Protokoll unterstützt — Cursor, VS Code mit Cline, Claude Desktop, Antigravity und andere. Denken Sie daran als ein Toolkit für die Dinge, mit denen KI Schwierigkeiten hat.

Müssen Sie eine Datei vor einer riskanten Refaktorierung speichern? Ein Befehl erstellt ein Backup. Wollen Sie in all Ihren Notizen aus jeder Sitzung suchen? Es gibt eine Volltextsuche dafür. Zwei API-Antworten vergleichen? Es macht semantische Diffs — zeigt Ihnen, was sich in den Daten tatsächlich geändert hat, nicht nur welche Zeilen sich bewegt haben.

Es hat eingebaute Web-Suche. URL-Lesen, das den Müll herausfiltert. Zwei Dutzend Textoperationen, die sonst Token verbrennen würden — URLs aus einer Seite extrahieren, Whitespace aufräumen, Formate normalisieren.

Es erkennt sogar automatisch sensible Informationen — API-Schlüssel, Passwörter, Tokens — und verschlüsselt sie im Ruhezustand, ohne dass Sie fragen.

Ich werde nicht so tun, als wäre dies die einzige Lösung. Aber es ist die, die ich jeden Tag benutze, und sie löst Probleme, für die ich anderswo keine guten Antworten finden konnte. Wenn irgendetwas davon resoniert, ist der Code Open Source auf GitHub.

Die Meta-Ebene

Bis jetzt haben wir darüber gesprochen, Ihren Workflow zu optimieren — die Prinzipien und Werkzeuge, die jede Sitzung besser machen.

Aber es gibt eine Ebene darüber. Eine Gewohnheit, die gute Operatoren von großartigen trennt.

Es ist dies: Überprüfen Sie sich selbst.

Nicht nur die Ausgabe der KI — Ihren eigenen Prozess. Am Ende einer Sitzung fragen Sie: Was hat funktioniert? Was nicht? Wo habe ich verwirrende Anweisungen gegeben? Wo hat die KI Aufwand verschwendet, weil ich nicht klar war?

Das ist Metakognition. Denken über das Denken. Und es ist der schnellste Weg, sich zu verbessern, weil jede Sitzung zu Daten wird.

Versuchen Sie dies: Nach Ihrer nächsten bedeutenden Arbeitssitzung bitten Sie die KI, Ihre Prompts zu analysieren. Welche Muster sieht sie? Was würde sie ändern? Sie werden etwas lernen. Jedes Mal.

Es gibt auch eine andere Version davon. Wenn die KI einen Fehler macht — eine veraltete Methode verwendet, eine Bibliotheksfunktion halluziniert, eine Einschränkung ignoriert — beheben Sie nicht nur den Code. Aktualisieren Sie Ihre Dokumentation. Fügen Sie die richtige Methode zu Ihrer Patterns-Datei hinzu. Fügen Sie die Einschränkung zu Ihren Regeln hinzu.

Der Fehler wird unmöglich zu wiederholen. Nicht weil die KI gelernt hat, sondern weil Ihr System es getan hat.

Wo Sie Von Hier Aus Hingehen

Wenn Sie neugierig sind, tiefer zu erkunden, gibt es einige ausgezeichnete Ressourcen da draußen.

Der offizielle Getting Started with Antigravity Guide führt Sie durch die Grundlagen. LogRocket hat einen umfassenden Entwicklerguide veröffentlicht, der tiefer in die agentischen Fähigkeiten geht. Und YouTube hat Dutzende von Tutorials — einschließlich dieser praktischen Demo, die den Workflow in Aktion zeigt.

Ich werde Ihnen hier keine Schritt-für-Schritt-Anweisungen geben. Teilweise weil diese Ressourcen bereits existieren, und sie gut sind. Aber hauptsächlich weil Erkunden wertvoller ist als Folgen. Öffnen Sie das MCP-Panel. Stöbern Sie in den Einstellungen. Sehen Sie, was möglich ist.

So lernen Sie, was für Sie funktioniert.

Warum Dies Über Die Technologie Hinaus Wichtig Ist

Aber es gibt noch etwas anderes, das ich Ihnen mitgeben möchte. Etwas, das ich eine Weile brauchte, um zu sehen.

Diese Prinzipien handeln nicht wirklich von KI. Sie handeln davon, Mensch zu sein.

Vor ein paar Jahren las ich Jordan Petersons 12 Rules for Life. Es ist ein seltsames Buch — teils Psychologie, teils Philosophie, teils Mythologie — und es blieb mir auf Weisen hängen, die ich nicht erwartet hatte. Als ich anfing, Muster darin zu bemerken, wie effektive KI-Operatoren arbeiten, wurde mir etwas Beunruhigendes klar: Die Prinzipien sind dieselben. Anderes Vokabular, dieselben Wahrheiten.

Lassen Sie mich Ihnen zeigen, was ich meine.

Petersons sechste Regel ist „Bringe dein Haus in perfekte Ordnung, bevor du die Welt kritisierst.” Die Idee ist einfach, aber tiefgründig: Bevor Sie versuchen, das Chaos da draußen zu beheben, beheben Sie das Chaos drinnen. Räumen Sie Ihr Zimmer auf. Organisieren Sie Ihr Leben. Bringen Sie Ihre eigenen Angelegenheiten in Ordnung. Nur dann haben Sie die Stellung — und die Klarheit — größere Probleme anzugehen.

Denken Sie jetzt an das erste Prinzip, das wir besprochen haben: Beginnen Sie mit einem Plan. Bevor Sie die KI bitten, etwas zu bauen, organisieren Sie Ihr eigenes Denken. Schreiben Sie auf, was Sie wollen. Bringen Sie Ihren Kontext in Ordnung. Die Parallele ist exakt. Die KI kann kein Problem beheben, das Sie nicht definiert haben. Und Sie können kein Problem definieren, während Ihr eigenes Denken über 30 Tabs verstreut ist.

Petersons zehnte Regel ist „Sei präzise in deiner Sprache.” Er argumentiert, dass vage Sprache vage Ergebnisse schafft — dass verschwommenes Denken sich durch unsere Worte ausbreitet und unsere Handlungen korrumpiert. Präzision ist keine Pedanterie. Es ist der Unterschied zwischen Problemen, die gelöst werden, und Problemen, die schwelen.

Das ist genau, warum Zerlegung funktioniert. Brechen Sie Aufgaben in Atome auf. Machen Sie sie so klar, dass „fertig” offensichtlich ist. Die Präzision Ihrer Sprache — Ihre Prompts, Ihre Specs, Ihre Definitionen — bestimmt, ob die KI etwas Nützliches liefert oder in die Büsche abschweift.

Dann gibt es Regel acht: „Sag die Wahrheit — oder, zumindest, lüge nicht.” Peterson rahmt dies als ethischen Imperativ, aber es ist auch praktisch. Lügen akkumulieren sich. Sie erfordern mehr Lügen, um aufrechterhalten zu werden. Schließlich kollabiert die Struktur.

KI-Halluzinationen sind Lügen einer anderen Art — nicht absichtlich, aber nicht weniger gefährlich. Das Modell sagt Ihnen etwas mit Zuversicht. Sie akzeptieren es ohne Verifizierung. Die Lüge breitet sich in Ihren Code, Ihren Bericht, Ihre Entscheidung aus. Der Verifizierungs-Imperativ ist nicht nur Effizienz. Es ist Epistemologie. Es ist das Engagement, auf Wahrheit zu bauen, nicht auf plausible Fiktion.

Regel sieben: „Verfolge, was bedeutsam ist, nicht was bequem ist.” Das Bequeme ist, die Planungsphase zu überspringen. Schnell zu prompten und auf das Beste zu hoffen. Die erste Antwort zu akzeptieren und weiterzumachen. Aber Bequemlichkeit hat einen Preis — die Nacharbeit, das Abdriften, die verschwendete Energie, Dinge zweimal zu machen.

Bedeutsame Arbeit erfordert Geduld. Sie bittet Sie, im Voraus zu investieren. Systeme zu bauen, die persistieren. Den schnellen Treffer gegen die dauerhafte Struktur einzutauschen. Jedes Prinzip in diesem Beitrag ist, auf gewisse Weise, eine Wahl von Bedeutung über Bequemlichkeit.

Und schließlich, Regel vier: „Vergleiche dich mit dem, wer du gestern warst, nicht mit dem, wer jemand anderes heute ist.” Das ist das Herz der Metakognition. Die Praxis, Ihre Prompts, Ihren Prozess, Ihre Muster zu überprüfen — und besser zu werden. Nicht besser als jemand anderes. Besser als die Version von Ihnen von gestern.

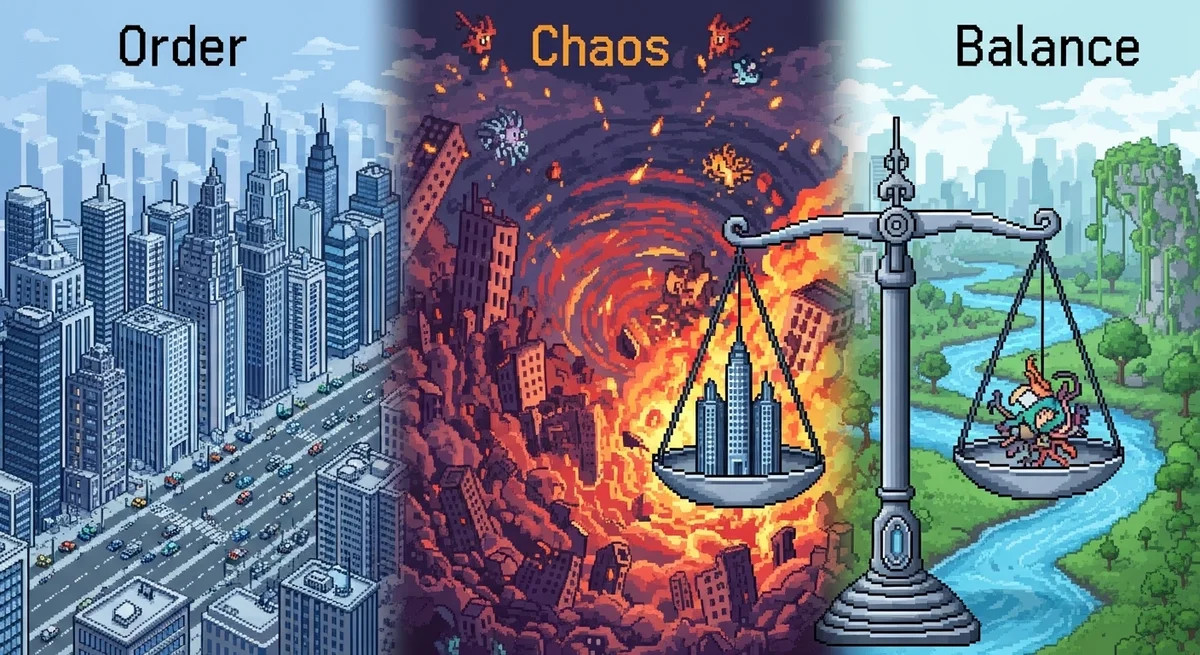

Hier ist, was ich glaube: Die Prinzipien, die KI funktionieren lassen, sind die Prinzipien, die das Leben funktionieren lassen. Ordnung besiegt Chaos. Wahrheit besiegt Verwirrung. Präzision besiegt Vagheit. Bedeutung besiegt Nihilismus.

KI ist nur das Medium. Die Botschaft ist so alt wie die Zivilisation.

Die Schlussfolgerung

Hier ist, was ich möchte, dass Sie sich merken:

Der Sprung von „Chat-KI” zu „agentischer KI” handelt nicht von besseren Prompts. Es geht darum, Systeme zu bauen, die persistieren. Pläne, die Sitzungen überleben. Kontext, der nicht degradiert. Verifizierung, die Fehler fängt. Ein externes Gedächtnis, dem Sie vertrauen können.

Das klingt nach mehr Arbeit. Und am Anfang ist es das.

Aber dann verschiebt sich etwas. Der kognitive Overhead sinkt. Sie hören auf, erneut zu erklären. Sie hören auf, Kontext zu verlieren. Sie hören auf, das wieder aufzubauen, was Sie bereits gebaut haben.

Und Sie beginnen, Ihre Energie für die Arbeit zu verwenden, die wirklich wichtig ist.

Es gibt hier auch eine tiefere Lektion. Die Prinzipien, die KI effektiv machen, sind dieselben Prinzipien, die Sie effektiv machen — als Denker, als Schöpfer, als Mensch. Ordnung. Wahrheit. Präzision. Bedeutung. Das sind keine Technik-Konzepte. Sie sind die Fundamente eines gut gelebten Lebens.

KI hat diese Ideen nicht erfunden. Sie hat sie nur wieder sichtbar gemacht.

Also ja, bauen Sie Ihre Workflows. Erstellen Sie Ihre Gedächtnis-Systeme. Bringen Sie Ihrer KI Gewohnheiten bei, die halten.

Aber vergessen Sie nicht: Sie lehren auch sich selbst.

Ich bin neugierig: Was ist eine repetitive Aufgabe, die Sie gerne nie wieder manuell machen würden — und was hat Sie davon abgehalten, sie zu automatisieren?

Ressourcen

- Pomera AI Commander (GitHub)

- Google Antigravity

- Antigravity Codelabs Guide

- Google Antigravity: Praktische Demo (YouTube)

- LogRocket: Antigravity und Gemini 3

- Google Blog: Gemini 3 für Entwickler

- Model Context Protocol (MCP)

- 12 Rules for Life von Jordan Peterson